Затеяли локальный ИИ на ПК: ожидание vs. реальность, или почему мой ноутбук чуть не взлетел

Привет, гики и просто любопытные! После новостей от Google про их Google I/O Gallery (где можно качать большие ИИ-модели прямо на телефон, весят они, правда, по 3+ ГБ!), мы с коллегой на работе загорелись идеей: “А на обычном-то компьютере такое можно? Должно же быть!”

И начались наши поиски. Нашли, конечно!

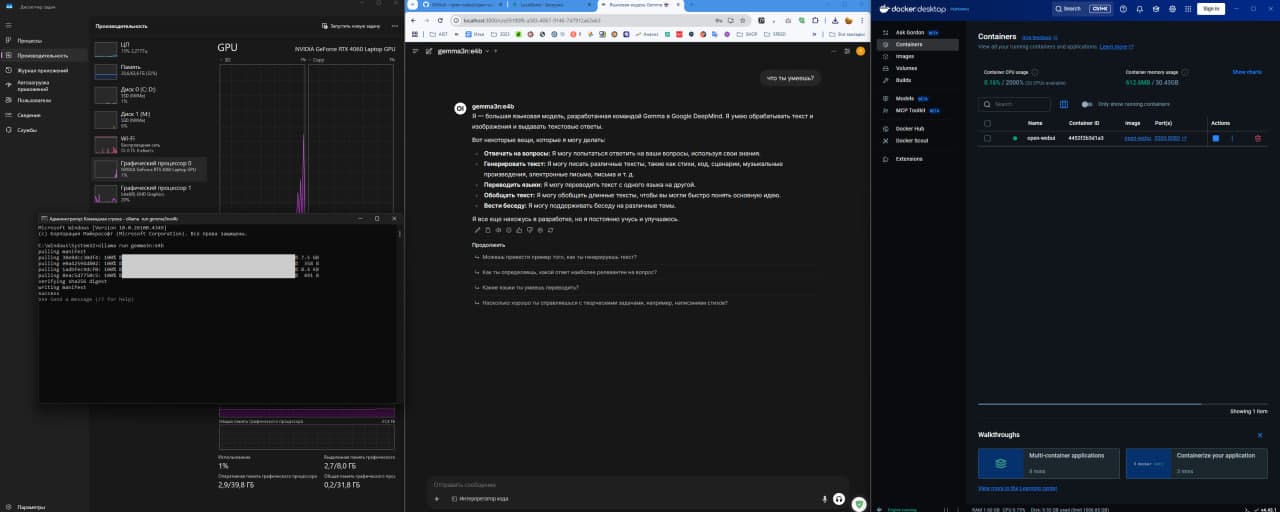

Народ в восторге от Ollama.com – сервиса, который позволяет запускать всякие крутые штуки типа DeepSeek-R1, Llama 3, Qwen, Gemma 3 и других ИИ-моделей прямо у себя на компе, локально. Звучит фантастически, правда? Скачали, установили… и уперлись в первый затык.

Шаг 1: терминал – это не для слабаков (и не для красивого чатика)

Ollama по умолчанию работает через терминал (командную строку). Ты пишешь команду, он тебе отвечает текстом. Полезно? Да! Но нам-то хотелось красоты и удобства, как в ChatGPT, DeepSeek Chat или JanitorAI – с окошечком, кнопочками, историей переписки. Ну, классический интерфейс!

Шаг 2: докер в бой! Ищем “лицо” для ИИ

Гугление привело нас к решению: Open WebUI. Это как раз тот самый веб-интерфейс, который превращает командную строку в удобный чат. Но чтобы его поставить, нужен был… Docker (это такая штука, которая упаковывает программы в “контейнеры” для легкого запуска).

Скачали Docker Desktop, настроили, прописали в терминале волшебную команду:

docker run -d -p 3000:8080 –add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data –name open-webui –restart always ghcr.io/open-webui/open-webui:main

– выглядело страшно, но сработало!. Ура! Интерфейс запустился по адресу localhost:3000.

Шаг 3: выбираем “мозги”!

Теперь можно было качать сами ИИ-модели через Ollama прямо в интерфейсе. А вот тут нас ждал главный сюрприз – размеры! Модели – это же по сути “мозги” ИИ. И весят они… от 5 до 300+ ГБ! Мы скачали пару штук: поменьше (Gemma 3) и побольше (Llama 3).

Шаг 4: запуск… и термоядерная реакция в ноуте

Нажали “Run”. И началось настоящее безумие:

- Процессор (CPU) взвыл. Загрузился под 70-80% и начал судорожно обрабатывать модель, потом упал до 40-50%. Шум вентиляторов – как взлетающий истребитель.

- Оперативка (ОЗУ) исчезла. У нас в ноуте стоит 64 ГБ DDR5 – казалось бы, запас! Ан нет. Модель буквально сожрала ~18 ГБ ОЗУ! И это еще не считая самой системы и Docker.

Мы сидели и ждали… долго. Минуты 4-5 прошло.

Оказалось, модель нужно не просто загрузить, а распаковать все её “нейроны” и “связи” (а их миллиарды!) в оперативку. Это заняло вечность (на самом деле минуты, но ощущалось как часы).

- Видеокарта (GPU) вступила в игру. После того как CPU и ОЗУ сделали свою часть, эстафету перехватила RTX 4060. Именно она начала обрабатывать наши запросы к ИИ. Нагрузка на неё тоже была приличной.

Шаг 5: общение с “локальным гением” – медленно, но факт

Наконец-то! Модель загрузилась. Мы попробовали пообщаться. Работало! ИИ понимал вопросы, давал осмысленные ответы.

Но… ОЧЕНЬ МЕДЛЕННО. Генерация даже короткого ответа занимала ощутимое время. Терпения хватило только немного поиграться.

Шаг 6: а что на Маке? Неожиданный поворот

Параллельно мы запустили ту же модель (поменьше, на 5 ГБ) на Mac mini с M2 и всего 8 ГБ ОЗУ. И знаете что? Работало ощутимо шустрее и стабильнее!

Почему? Всё дело в архитектуре Apple Silicon (M1/M2/M3). Их процессоры и память (с единой сверхбыстрой шиной – Unified Memory) заточены под такие задачи. На обычном ПК/ноутбуке с дискретной видеокартой данные между CPU, ОЗУ и GPU “путешествуют” по относительно медленным магистралям, что и создает бутылочное горлышко. На M2 – все компоненты “общаются” намного эффективнее.

Итоги и выводы (честно и без прикрас)

- Локальный ИИ – это реально? Да! С Ollama + Open WebUI (через Docker) это стало довольно просто технически.

- Это быстро и легко для всех? Пока нет! Требования к железу космические:

- ОЗУ: Минимум 16 ГБ, а для серьезных моделей – 32-64 ГБ+. Имейте в виду, модель “съест” львиную долю!

- Видеокарта: Мощная (RTX 3060/4060 и выше) очень желательна для ускорения.

- Процессор: Быстрый многоядерник.

- Место на диске: Десятки гигабайт под модели.

- Скорость. На обычном x86 ПК/ноутбуке (даже мощном) будет МЕДЛЕННО по сравнению с облачными сервисами вроде ChatGPT. Запаситесь терпением.

- Тепловыделение. Будет не очень ГОРЯЧО. Ноутбук не превратится в грелку. А настольный ПК – в обогреватель…

- Apple Silicon (M1/M2/M3) – темная лошадка. Показывают значительно лучшую эффективность при меньшем объеме ОЗУ именно для таких ИИ-задач. Это их сильная сторона.

- Зачем это нужно? Для экспериментов, конфиденциальных данных (всё локально!), работы без интернета, глубокого изучения моделей. Для повседневного чата – пока неудобно.

Финал мысли

Запустить мощный ИИ локально – это крутой технический эксперимент и шаг в будущее. Но прямо сейчас это скорее удел энтузиастов с очень мощным (или специфическим, как Mac на M-серии) железом. Если у вас обычный ноутбук или средний ПК – готовьтесь к долгой загрузке, тормозам и напрягу вентиляторов. Но сам факт, что это возможно на домашней машине – уже впечатляет! Будущее точно будет интересным.

P.S. А тем, кто захочет попробовать – вот ключевые ссылки (осторожно, требует технических навыков!):

- Ollama (основа): https://ollama.com/

- Docker Desktop (для Open WebUI): https://www.docker.com/products/docker-desktop/

- Open WebUI (красивый интерфейс): https://github.com/open-webui/open-webui

Пробуйте, экспериментируйте, но будьте готовы к нагрузке!